Por Isabela Cabral, 28/07/2018 - Inteligência artificial é usada para fazer montagem com famosos e políticos, substituindo rostos e vozes em vídeos realistas; novidade traz preocupações éticas. O deepfake é uma tecnologia que usa inteligência artificial (IA) para criar vídeos falsos, mas realistas, de pessoas fazendo coisas que elas nunca fizeram na vida real. A técnica que permite fazer as montagens de vídeo já gerou desde conteúdos pornográficos com celebridades até discursos fictícios de políticos influentes. Circulam agora debates sobre a ética e as consequências ...

Por Isabela Cabral, 28/07/2018 - Inteligência artificial é usada para fazer montagem com famosos e políticos, substituindo rostos e vozes em vídeos realistas; novidade traz preocupações éticas. O deepfake é uma tecnologia que usa inteligência artificial (IA) para criar vídeos falsos, mas realistas, de pessoas fazendo coisas que elas nunca fizeram na vida real. A técnica que permite fazer as montagens de vídeo já gerou desde conteúdos pornográficos com celebridades até discursos fictícios de políticos influentes. Circulam agora debates sobre a ética e as consequências ...

da tecnologia, para o bem e para o mal. O termo deepfake apareceu em dezembro de 2017, quando um usuário do Reddit com esse nome começou a postar vídeos de sexo falsos com famosas. Com softwares de deep learning, ele aplicava os rostos que queria a clipes já existentes. Os casos mais populares foram os das atrizes Gal Gadot e Emma Watson. A expressão deepfake logo passou a ser usada para indicar uma variedade de vídeos editados com machine learning e outras capacidades da IA.

Efeitos especiais de computador que criam rostos e cenas no audiovisual não são nenhuma novidade; o cinema faz isso há muitos anos. A grande virada do chamado deepfake está na facilidade com que ele pode ser produzido. Comparado ao que costumava ser necessário, o método atual é simples e barato. Qualquer um com acesso a algoritmos e conhecimentos de deep learning, um bom processador gráfico e um amplo acervo de imagens pode criar um vídeo falso convincente.

Como os deepfakes são criados

São utilizados softwares baseados em bibliotecas de código aberto voltadas ao aprendizado de máquina. Segundo entrevista ao site Motherboard, o usuário do Reddit usou TensorFlow aliado ao Keras, uma API de deep learning escrita em linguagem Python. O programador fornece centenas e até milhares de fotos e vídeos das pessoas envolvidas, que são automaticamente processadas por uma rede neural. É como um treinamento, no qual o computador aprende como é determinado rosto, como ele se mexe, como ele reage a luz e sombras.

Esse “treino” é feito com o rosto do vídeo original e com o novo rosto, até que o programa seja capaz de encontrar um ponto comum entre as duas faces e “costurar” uma sobre a outra. O procedimento envolve uma espécie de truque, em que o software recebe uma imagem da pessoa A e a processa como se fosse a pessoa B.

Leia também - Lâmpada de lava

O deepfake é muito recente e sua definição é fluida. O fenômeno se confunde na discussão pública com tecnologias com funções similares ou complementares. Há, por exemplo, um programa anunciado pela Adobe que consegue criar falas com a voz de uma pessoa a partir de amostras reais. Existem ainda experimentos de reencenação facial, com a recriação das mesmas falas e expressões de uma pessoa no rosto de outra, e de sincronização labial, vídeos de alguém falando gerado com áudio e imagens de seu rosto.

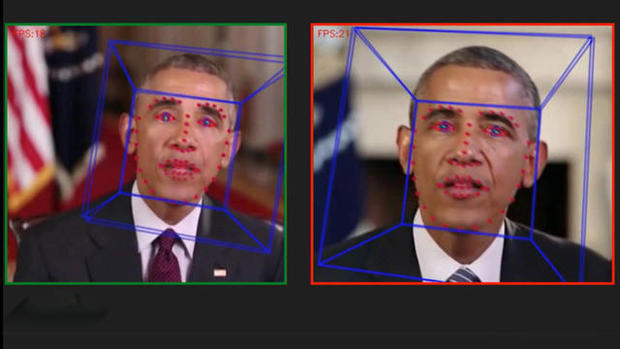

Além dos clipes pornográficos, outros vídeos falsos criados com inteligência artificial que ganharam notoriedade mostram o ex-presidente americano Obama. Em um deles, ele chama o atual presidente dos EUA, Donald Trump, de “um completo m*rda”. Em outro, faz discursos que só existiam em áudio ou na forma escrita. Há também um vídeo de Trump produzido com imagens e falas de uma paródia do presidente no programa de humor Saturday Night Live.

Riscos e consequências

Normalmente, vídeos desse tipo não são perfeitos, mas são realistas o suficiente para enganar muita gente. Má intenção não faz parte do conceito dos deepfakes, mas está na equação. A manipulação das imagens e vozes de políticos se mostra como um alerta. Com ferramentas tão acessíveis, fica mais fácil espalhar informações falsas de acordo com interesses próprios, fundamentadas por supostas provas em vídeo. Isso pode representar um perigo para a democracia e a sociedade, inclusive ameaçando a credibilidade de tudo o que é publicado.

No caso dos vídeos pornô fictícios, inclui-se ainda problemas éticos e legais complexos, de teor mais individual. As criações enganosas podem prejudicar a vida de uma pessoa, seja ela famosa ou anônima, e, por enquanto, não se sabe ao certo o que a Justiça pode fazer a respeito. Os vídeos divulgados não são reais; é a face de um inserida no corpo de outro. Porém, se as imagens conseguem se passar como verdadeiras e não há consentimento do indivíduo em questão, como lidar?

Alguns já levantam também questionamentos sobre a possível banalização do termo, de modo semelhante ao que aconteceu com a expressão fake news. A preocupação é que a palavra deepfake passe a ser usada de maneira muito vaga e casual e se torne onipresente, mais forte que o real impacto da tecnologia. Assim, pessoas mal intencionadas podem se aproveitar para lançar dúvidas sobre evidências verdadeiras que não as agradam.

Usos benéficos da tecnologia

Não há só pessimismo no mundo dos deepfakes. Existem exemplos de uso positivo dos algoritmos de machine learning que deram vida ao novo fenômeno. O princípio da tecnologia está no reconhecimento e na reconstrução facial, o que indica um enorme potencial. Na verdade, funções semelhantes já são empregadas em recursos presentes no dia a dia dos usuários da Internet. Os animojis da Apple e os AR emojis da Samsung mapeiam a face de uma pessoa e reproduzem em tempo real suas expressões em bonecos virtuais. No Instagram Stories e no Snapchat, diversos filtros detectam e transformam os rostos dos usuários. Há inclusive um filtro de troca de rostos entre as pessoas de uma foto.

O cinema e toda a indústria audiovisual também poderia se beneficiar de um método mais simples de executar efeitos especiais com faces, especialmente no caso de produtores de conteúdo independentes com baixos orçamentos. Celebridades e influenciadores digitais poderiam vender suas imagens para anunciantes sem precisarem comparecer a filmagens.

Em entrevista ao site Mashable, porém, o diretor da MultiComp Lab, parte da Universidade de Carnegie Mellon, afirmou que essa tecnologia pode vir a ter aplicações importantes para além do entretenimento. De acordo com o pesquisador, se desenvolvidos com qualidade suficiente para operarem em tempo real, os softwares poderiam servir para oferecer terapia por videoconferência — útil a indivíduos que não se sentem confortáveis em mostrar o rosto. Ou para fazer entrevistas de emprego sem vieses de gênero ou raça.

Como reconhecer um deepfake

Agora que os deepfakes fazem parte da nossa realidade, é essencial aprender a identificá-los. Pode ser que cheguemos a um ponto em que isso seja impossível ou muito difícil, mas hoje ainda existem alguns detalhes que ajudam a revelar um vídeo falso. Preste atenção nos movimentos da boca, se eles correspondem bem ao que está sendo dito. Fique atento também para a própria voz: a entonação e o tom soam normais?

Verifique os olhos para notar se eles estão piscando. Na maioria das vezes, os algoritmos não reproduzem bem esse aspecto nem a respiração da pessoa. Veja ainda se ela se mexe de forma natural como um todo. As recriações podem ter dificuldade em encaixar todas as partes do rosto e do resto do corpo e duplicar certos movimentos orgânicos. E se a pessoa no vídeo em questão é alguém que você não conhece bem, procure outros clipes, de preferência em que haja certeza de veracidade, para comparar.

Entenda como as deepfakes podem mudar todo o mundo como conhecemos

Por Rafael Rodrigues Da Silva, 16/07/2019 - Como sabemos, os avanços tecnológicos acabam servindo como base para diversas mudanças que ocorrem em nossa sociedade, já que ela precisa se adequar para os problemas causados pelo uso dessa tecnologia. Por exemplo, até bem pouco tempo atrás não existiam leis para o que empresas poderiam fazer com nossos dados cadastrais, pois isso não era um problema até companhias como Google e Facebook começarem a vender esses dados para anunciantes, fato que acabou fazendo com que, nos últimos anos, diversos países aprovassem legislações específicas sobre o assunto.

O mesmo tipo de mudanças pode ocorrer com a popularização dos deepfakes — vídeos criados por um software de inteligência artificial, que consegue utilizar fotos e gravações da voz de uma pessoa para criar um vídeo falso dela, mostrando não apenas ela fazendo algo que nunca fez como ainda dizendo algo que nunca disse. Por exemplo, alguém poderia pegar fotos de suas redes sociais e seus vídeos do Stories do Instagram, passar todas essas coisas por um algoritmo que processaria o seu rosto e a sua voz, e criar um vídeo onde você está fazendo polichinelos enquanto brinca de bambolê em cima da muralha da China enquanto recita o poema O Corvo, de Edgar Alan Poe — e tudo vai parecer muito convincente mesmo que você não saiba brincar de bambolê, nunca chegou nem perto da China e nem faz ideia de qual é o poema que eu estamos falando.

Por esse motivo, a popularização dos deepfakes é uma das maiores preocupações de governantes, juristas e jornalistas em todo o mundo, pois ela ataca algo que até então era certeiro: a credibilidade de uma gravação em vídeo. Um político poderia jurar que nunca roubou nada durante o seu mandato, mas se algum jornalista consegue filmar um vídeo em que o tal político está escondendo milhares de dólares na cueca para não ser pego pela alfândega, não havia o que ser feito além de assumir a culpa — e, com os deepfakes, isso não mais é verdade.

Ainda que muitos dos deepfakes atuais sejam fáceis de perceber que não passam de montagem, os avanços na tecnologia permitirão que se torne cada vez mais difícil distinguir um vídeo real de uma montagem criada por algoritmos, e é exatamente isso que deverá causar diversos impactos na nossa sociedade.

Leia também - Estudo aponta que as crianças não conhecem 25% dos seus amigos do Facebook

Política

Provavelmente, um dos primeiros setores a serem afetados pelo uso de deepfakes será o cenário político, principalmente em época de eleições. Atualmente, o cenário político-eleitoral já é um dos mais afetados pela propagação de boatos inventados e fake news, e a criação de um dispositivo como os deepfakes não é algo que deverá ser positivo, principalmente em um cenário político mundial tão dividido como o que temos hoje.

E o uso desse processo se torna ainda mais perigoso pelo fato de a maioria dos eleitores não conseguir identificar que se trata de uma montagem. E isso é provado por dois deepfakes que fizeram bastante sucesso nos Estados Unidos este ano: um de Nancy Pelosi, presidente da Câmara dos Representantes (equivalente à nossa Câmara dos Deputados), que foi editado para que ela parecesse bêbada durante um de seus discursos em sessão da Câmara, e outro do senador (e também candidato um dos candidatos a presidente pelo Partido Democrata na próxima eleição) Bernie Sanders, onde o rosto do político foi sobreposto sobre um vídeo de um dos candidatos do programa America’s Got Talent, fazendo com que Bernie Sanders parecesse que estava cantando a música Bodies, da banda Drowning Pool.

O mais preocupante é que ambos vídeos foram criados a partir de um algoritmo bem “cru”, e é fácil notar que se tratam de montagens — mas, mesmo assim, ambos os conteúdos foram compartilhados por milhares de pessoas que acreditaram se tratar de algo real. Claro, uma boa parte dos compartilhamentos foi de forma “irônica”, pra fazer graça da situação, mas o fato de entre essas pessoas existirem muitas que compartilharam esses vídeos como se realmente fossem reais é preocupante.

Principalmente porque, mesmo que um especialista em vídeo crie uma explicação detalhada sobre o porquê de aquele vídeo em si ser falso, esses conteúdos nunca viralizam na mesma proporção dos vídeos falsos, fazendo com que muitas pessoas não tenham acesso a essa explicação. Além disso, também não podemos descontar algo conhecido como “viés de confirmação”: muitas pessoas, por qualquer motivo que seja, já não gostam de Pelosi ou de Sanders, e ao entrar em contato com esse vídeo eles terão certeza de que são reais, pois confirmam um pré-julgamento negativo que faziam deles. Nesses casos, mesmo aqueles que entrem em contato com o vídeo do especialista explicando que se tratam de vídeos falsos acharão alguma justificativa para desacreditar o especialista — normalmente acusando-o de ser contratado pelo partido dos candidatos para defendê-los dessas “provas incontestáveis” de como são a escória da terra — pelo simples motivo de que é mais fácil assumir que um suposto especialista está tentando enganá-las, do que assumir que suas posições sobre uma pessoa podem estar erradas.

É por essa preocupação que, nos Estados Unidos, a Representante do Estado de Nova York Yvette Clarke propôs o “Ato de Prestação de Contas sobre Deepfakes”, que irá responsabilizar os criadores desses vídeos falsos por qualquer influência que eles podem ter em manchar a honra ou a credibilidade de pessoas reais.

Ainda que crie um mecanismo de punição, esse Ato não irá solucionar o problema, já que o próprio modo como a internet funciona deverá significar que, se um desses vídeos ganhou a atenção de um “público geral” a ponto de ser considerado um problema pelo Departamento de Justiça e angariar punição aos seus criadores, isso quer dizer que ele já circulou e foi visto por milhares (senão milhões) de pessoas, que já tiveram suas opiniões modificadas pelo conteúdo daquela montagem — ou seja, o estrago já foi feito.

Assim, essa tecnologia das deepfakes pode acabar por aproximar os representantes do governo das grandes empresas de tecnologia (como Google e Facebook) e especialistas em edição de vídeo, que deverão criar métodos de identificar que um vídeo é um deepfake já no momento do upload e inserir automaticamente nele algum tipo de selo ou marca d’água digital que seja impossível de remover e deixe claro para qualquer um que assistir que se trata de uma montagem. Mas mesmo isso pode não ser o suficiente, pois mesmo com um selo desses, é capaz de muitas pessoas passarem a acreditar que tais selos são uma forma de perseguição a algum tipo de viés político, e não uma forma de identificação de vídeos falsos.

Economia

Não é apenas o cenário político que essas montagens em vídeo podem mudar, mas a própria economia de um país — principalmente em países onde há uma enorme concentração de capital financeiro proveniente da compra e venda de ações.

Em junho deste ano, um deepfake do criador do Facebook, Mark Zuckerberg, mostra o dono da rede social dando declarações polêmicas sobre o fato de saber os segredos de milhões de pessoas do mundo. No caso, a declaração não causou nenhum transtorno porque ela já foi compartilhada como um vídeo falso, feito para mostrar o poder da deepfake. Mas algo do tipo pode ser usado para colocar a economia de um país em declínio.

Como o valor das ações de empresas variam muito não apenas por contratos firmados e aquisições de outras companhias, mas também por rumores de mercado e declarações de presidentes e CEOs. Lembram aquele tweet do Musk falando que a Tesla estava próxima a conseguir o financiamento para se tornar uma empresa de capital fechado? O puro fato do CEO dar um tweet desses de madrugada, provavelmente chapado, fez com que o valor da empresa aumentasse em alguns milhões e, ao todo mundo perceber que era uma informação falsa, Musk e Tesla foram duramente multados por estarem manipulando o mercado financeiro com mentiras.

Agora, se um simples tweet tem esse poder, imagina o que um vídeo não pode influenciar? Por exemplo, um vídeo falso de Bill Gates falando que odeia negros e judeus poderia ser o suficiente para criar uma enorme crise de imagem na Microsoft e derrubar o valor de mercado de uma das maiores companhias do mundo, o que por sua vez traria repercussões para todo o mercado de informática mundial, o que iria afetar negativamente a economia de praticamente todos os países mais ricos do mundo.

Assim, é possível que alguém mal-intencionado e com um bom algoritmo para criação de deepfakes utilize esse material para manipular a economia mundial, seja em proveito próprio (por exemplo, vendendo ações de empresas logo antes de soltar um vídeo incriminador do CEO dessas empresas, fazendo com que o valor delas caia e aumentando seus lucros) ou então até mesmo para colocar em parafuso a economia do mundo todo. Lembram da cena final do filme Clube da Luta, em que o prédio onde está o servidor das companhias de cartão de crédito é destruído? Com o uso de deepfakes, é possível hoje criar o mesmo efeito de caos no mundo econômico apenas com uma série de vídeos polêmicos protagonizados pelos principais CEOs do mundo.

Sistema de justiça

E não é apenas o cenário político e econômico que as deepfakes deverão mudar para sempre, mas também todo o sistema judiciário. E tudo isso por um ponto que já citamos lá no começo da matéria: provocar o descrédito de provas em vídeo.

Ainda que, atualmente, seja fácil identificar a olho nu uma montagem criada por algoritmos, isso acontece porque esses vídeos normalmente são feitos em locais bem iluminados e em um vídeo de alta resolução. Agora, caso estejamos falando de um vídeo falso de câmera de segurança (onde muitas vezes a qualidade da iluminação e da própria gravação são bem baixos), fica praticamente impossível de distinguir a olho nu se as imagens mostradas se tratam de um vídeo real ou de uma montagem, o que pode fazer com que evidências em vídeo passem a ser desconsideradas em júris e tribunais.

E isso seria um enorme baque para o sistema de justiça em todo o mundo. Hoje, provas coletadas em vídeo ou gravações telefônicas são algumas das mais contundentes que se podem apresentar em tribunal, e se o avanço da tecnologia obrigar que esses materiais sejam desconsiderados em julgamento pelo fato de ser impossível para um júri distinguir se aquele material é real ou não não apenas atrapalhará muitos dos casos criminais que já estão sendo investigados hoje, mas também nos obrigará a repensar toda a estrutura do próprio sistema judiciário em si.

A mesma preocupação pode ser utilizada para os algoritmos de reconhecimento facial usado por diversos departamentos de polícia ao redor do mundo: ainda que a ideia seja facilitar a identificação de foragidos da justiça, os números não estão a favor da tecnologia: em Londres, 81% das pessoas identificadas como criminosos por essas IAs eram, na verdade, inocentes, e nos Estados Unidos há casos de pessoas que foram presas injustamente por conta de serem acusadas como criminosas por tais sistemas.

Fica claro que a tecnologia de deepfakes é algo que talvez tenha chegado muito mais rápido do que estávamos preparados para lidar, e certamente irá causar diversas mudanças no mundo pelo simples fato de existir. Mas ninguém sabe dizer ainda se essas mudanças acontecerão antes que ela seja usada para causar algum estrago sem precedentes em nossa sociedade.

Deepfake será a 'vilã' da segurança digital em 2020, diz relatório

Por Ana Letícia Loubak, 07/12/2019 - Com os mais recentes avanços em inteligência artificial, qualquer pessoa pode produzir vídeos falsos convincentes. A tecnologia deepfake, que usa aprendizado de máquina e inteligência artificial (IA) para criar vídeos falsos, é uma das maiores ameaças à segurança digital em 2020. Esta é a conclusão da McAfee em um relatório publicado na última quarta-feira (4). Segundo a empresa, recentes avanços em IA deram a criminosos menos qualificados a capacidade de produzir clipes convincentes, nos quais a pessoa faz algo que nunca fez na vida real. A tecnologia, inclusive, é usada com frequência na produção de vídeos pornográficos e já fez vítimas famosas, como Gal Gadot, Emma Watson e Barack Obama.

"Os contínuos avanços em inteligência artificial e aprendizado de máquina levaram a ganhos tecnológicos inestimáveis, mas os atores de ameaças também estão aprendendo a alavancá-los de maneiras cada vez mais sinistras", disse Raj Samani, cientista chefe da McAfee.

No documento, a empresa ressalta que a capacidade de criar conteúdo falso não é nova. O que mudou agora é que é possível produzir vídeos falsos muito convincentes sem ser expert em tecnologia. Além de ferramentas audiovisuais gratuitas que oferecem a qualquer pessoa recursos capazes de manipular imagens de forma realista, existem empresas que vendem o serviço online.

"Deepfakes podem se transformar em armas para intensificar a guerra de informação", afirma Steve Grobman, diretor de tecnologia da empresa. O aumento do alcance da técnica de manipulação de imagens preocupa governos e autoridades internacionais. Pensando em diminuir o impacto dos deepfakes nas eleições presidenciais de 2020, o Congresso dos Estados Unidos entrou em ação contra os vídeos falsos.

"Os adversários tendem a usar a melhor tecnologia para atingir seus objetivos. Por isso, se pensarmos em atores estatais tentando manipular uma eleição, usar vídeos deepfake para influenciar a audiência faz muito sentido. Eles tentarão criar divisões na sociedade", completa Grobman. A McAfee alerta ainda que o reconhecimento facial, tecnologia cada vez mais presente no dia a dia, pode ser comprometida com o avanço dos deepfakes.

Leia também - Metamateriais

"Computadores aprimorados podem processar rapidamente inúmeras biometrias de uma face e criar ou classificar matematicamente características humanas", explica Steve Povolny, chefe de pesquisas de ameaças avançadas da McAfee. Segundo ele, as empresas e entidades governamentais devem estar a par desses riscos e investir no fortalecimento dos sistemas de segurança.

Outras ameaças para 2020

Os deepfakes não são a única ameaça para a segurança digital em 2020. A McAfee alerta que os ataques de ransomware continuarão a crescer e darão lugar a ataques de sextorsão em dois estágios. As APIs (Application Programming Interface ou Interface de Programação de Aplicações, em português) também estão ameaçadas e podem ser expostas a partir de vulnerabilidades nativas nos serviços em nuvem. Por último, a empresa destacou a importância da abordagem DevSecOps (Desenvolvimento + Segurança + Operação, em português) para reforçar a segurança de softwares desenvolvidos a partir da chamada tecnologia de containers.

Fonte: https://www.techtudo.com.br/

https://qz.com/

https://www.mcafee.com/