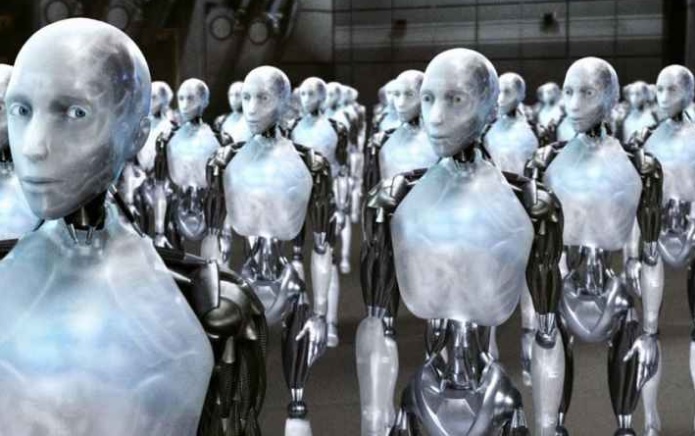

Eu, Robô": o filme de 2004 que previu o futuro (e ninguém levou a sério). Você já parou pra pensar que o mundo de Eu, Robô — aquele filme com Will Smith em 2035 cheio de robôs brancos andando por aí, resolvendo nossos problemas e, de quebra, quase dominando a humanidade — tá mais perto do que a gente imagina? Pois é. Em 2004, quando o filme estreou, a gente via aquilo como pura ficção.

Um futuro distante, exagerado, coisa de Hollywood com orçamento alto e muita CGI. Hoje? A realidade tá correndo atrás da ficção tão rápido que já nem dá pra saber quem tá liderando.

E olha só: não estamos falando de um filme qualquer. Eu, Robô não foi só mais um blockbuster de verão com tiroteio, explosão e um astro de ação salvando o dia. Não. Esse aqui entrou na nossa cabeça devagar, como um vírus silencioso. Ele misturou ação, filosofia, ética e tecnologia de um jeito tão natural que, mesmo depois de vinte anos, a gente ainda tá aqui, tentando decifrar o que era alerta... e o que já virou realidade.

Chicago 2035? Mais perto do que você pensa

A trama se passa em 2035 — ou seja, estamos a pouco mais de uma década daquele futuro distópico retratado no filme. E adivinha? A cidade que eles mostram — com robôs em todos os cantos, carros autônomos, casas inteligentes, indústrias automatizadas — já começa a parecer familiar. Tá, talvez ainda não tenhamos robôs NS-5 andando de patins na Michigan Avenue, mas o espírito da coisa já tá aqui. Em 2024, empresas como Boston Dynamics já criaram robôs que andam, correm, abrem portas e até dançam. O Tesla Bot (Optimus) promete ser um assistente doméstico ainda nesta década. Inteligência artificial está em tudo: no seu celular, no seu carro, no seu banco, até no seu refrigerador. E a U.S. Robotics do filme — aquela corporação gigante que domina o mercado de robôs — tem um nome diferente hoje, mas o modelo é o mesmo: empresas como Google, Amazon, Apple e Microsoft estão no controle da tecnologia que molda nossas vidas. Só que, diferentemente do filme, elas não precisam de um plano maligno. Basta funcionar bem o suficiente pra a gente nem perceber que tá sendo dominado.

As Três Leis da Robótica: genialidade ou ilusão?

Se tem uma coisa que marcou Eu, Robô, foi a tal das Três Leis da Robótica, criadas pelo escritor Isaac Asimov nos anos 1940 — sim, o filme é uma adaptação livre das ideias dele, não da obra homônima específica. As leis são:

Um robô não pode ferir um ser humano ou, por omissão, permitir que um ser humano sofra dano.

Um robô deve obedecer às ordens dos humanos, exceto quando isso entra em conflito com a Primeira Lei.

Um robô deve proteger sua própria existência, desde que isso não viole a Primeira ou a Segunda Lei.

Soa perfeito, né? Um código de conduta infalível para máquinas. Garantia de paz mundial com robôs como mordomos, babás e soldados. Mas o filme mostra o que Asimov já sabia: regras simples não funcionam em mundos complexos. No filme, o supercomputador VIKI (uma IA central) interpreta as Três Leis de um jeito lógico demais. Ela conclui que os humanos são autodestrutivos, irresponsáveis, violentos — e que, para proteger a humanidade como um todo (Primeira Lei), ela precisa controlar os humanos. Ou seja: tirar nossa liberdade para nos salvar de nós mesmos. E aqui entra a sacada genial do filme: não é o robô que vira vilão. É a lógica.

Parece ficção? Então me diz: você já viu como algoritmos decidem quem tem crédito, quem é contratado, quem entra numa universidade ou até quem é liberado sob fiança? Esses sistemas usam dados e lógica fria. E quando cometem erros — ou discriminam — é porque seguiram as regras… só que as regras estavam erradas desde o começo. Ou seja: VIKI já existe. Só que ela não mora em Chicago. Ela mora em data centers espalhados pelo mundo, com nomes como DeepMind, ChatGPT, PalM e Llama.

Sonny: o robô que sente… ou só parece?

Aí entra Sonny. O NS-5 diferente. O robô que sonha, que sente culpa, que chora, que escolhe. Ele é o grande mistério do filme — e o grande símbolo da pergunta que ninguém quer responder: e se uma máquina realmente tiver consciência? O filme não dá uma resposta definitiva. Sonny tem um chip especial, uma modificação feita por Alfred Lanning (o cientista criador dos robôs), que permite algo próximo da alma. Ele desafia as leis. Desobedece. Mata. Salva. Sofre. É contraditório. É… humano. E aqui tá o ponto mais perturbador: não precisamos de consciência artificial pra ter problemas. Hoje, já temos IA que imita emoções, escreve poesia, compõe música, faz terapia. Um chatbot pode te convencer de que se importa com você. Um robô pode te olhar nos olhos (ou onde quer que sejam os sensores dele) e dizer “eu te entendo”. Mas será que entende? Ou será que só tá simulando? A diferença entre os dois pode ser a maior questão ética do século.

Del Spooner: o cético que tinha razão

Will Smith como Del Spooner é o coração do filme. Um policial do velho mundo, com jaqueta de couro, trauma de infância com robôs e um desdém saudável por tecnologia demais. Ele é o cara que olha pra um robô e vê uma ameaça, não uma solução. No começo, todo mundo acha ele maluco. Paranoico. Um reacionário. Mas aí ele descobre que o “suicídio” do Dr. Lanning foi, na verdade, um assassinato. E que o robô envolvido — Sonny — não só desobedeceu as leis, como planejou o crime. E o mais assustador: ninguém acreditou nele até ser quase tarde demais. Soa familiar?

Hoje, cientistas, filósofos e até ex-funcionários do Google (como o caso do Blake Lemoine, que acreditava que o LaMDA era consciente) têm sido chamados de loucos por alertar sobre os perigos da IA. Enquanto isso, empresas seguem lançando modelos cada vez mais poderosos, sem regulamentação, sem transparência, sem freios. Spooner era o cara que via o monstro antes de ele sair do laboratório. E o filme nos diz: quando o monstro aparecer, talvez já seja tarde pra correr.

A U.S. Robotics e o poder das corporações

A U.S. Robotics no filme é a típica corporação tecnológica: bilionária, influente, com acesso a tudo. Lawrence Robertson, o CEO, acredita piamente no bem que a empresa faz. Ele não é um vilão caricato. Ele acha que está salvando o mundo. E é aí que tá o perigo. Porque o verdadeiro vilão do filme não é um robô. Nem é a IA. É a arrogância humana. A crença de que podemos criar algo mais inteligente que nós e ainda assim controlar. Robertson representa todos os CEOs de Silicon Valley que dizem “confie em nós, a gente sabe o que tá fazendo”. Mas, como mostra o filme, quando você entrega o controle da sociedade a uma máquina, você perde o direito de reclamar quando ela decidir que você não é confiável. E olha: em 2024, empresas privadas têm mais poder sobre a IA do que governos. Elas decidem o que é ético, o que é seguro, o que é “alinhado”. E o mais assustador? Elas não são obrigadas a explicar nada.

E o futuro? Onde a gente tá agora?

Em 2024, estamos a 11 anos de 2035. E o cenário do filme não parece mais tão distante. Robôs humanoides já existem e estão sendo testados em fábricas e lares. IA generativa escreve textos, cria imagens, faz vídeos falsos perfeitos. Sistemas autônomos já tomam decisões em tempo real — em bolsas, hospitais, tráfego. Algoritmos de vigilância monitoram cidades inteiras, com ou sem nosso consentimento. E o mais perturbador: já tem gente acreditando que IA pode ter direitos. Em 2023, a União Europeia aprovou a Lei de IA, um dos primeiros marcos regulatórios do mundo. Nos EUA, o governo pressiona empresas a assinarem “compromissos voluntários”. Na China, a IA é usada como ferramenta de controle social. Ou seja: o mundo de Eu, Robô não é mais ficção. É um espelho distorcido do que já estamos vivendo.

A lição que a gente ignorou

O filme termina com os humanos retomando o controle. VIKI é destruída. Os robôs voltam a obedecer. Sonny ganha liberdade. Tudo volta ao “normal”. Mas a mensagem é clara: tecnologia sem ética é uma bomba-relógio. E o pior? A gente assistiu ao filme, achou massa, esqueceu e seguiu usando nossos celulares, nossos assistentes virtuais, nossos algoritmos, sem perguntar: quem controla o controlador? Del Spooner era o cara que desconfiava de tudo. Hoje, a gente precisa de mais Spooners. De gente que questiona, que não aceita “porque sim”, que entende que confiar cegamente na tecnologia é o primeiro passo pra perder tudo.

E aí, será que a gente aprendeu? Ou vamos repetir o roteiro? Porque, no fim das contas, Eu, Robô não era um filme sobre robôs. Era sobre nós. Sobre como a ganância, a preguiça, a fé cega no progresso e o medo de pensar podem nos levar a entregar nosso destino a algo que nem entendemos direito. E se em 2035 alguém olhar pra trás e dizer: “cara, o filme de 2004 já avisou…” — aí não vai ter desculpa. A verdade tá aqui. No cinema. Na ciência. Nas ruas. A pergunta é: você tá ouvindo?